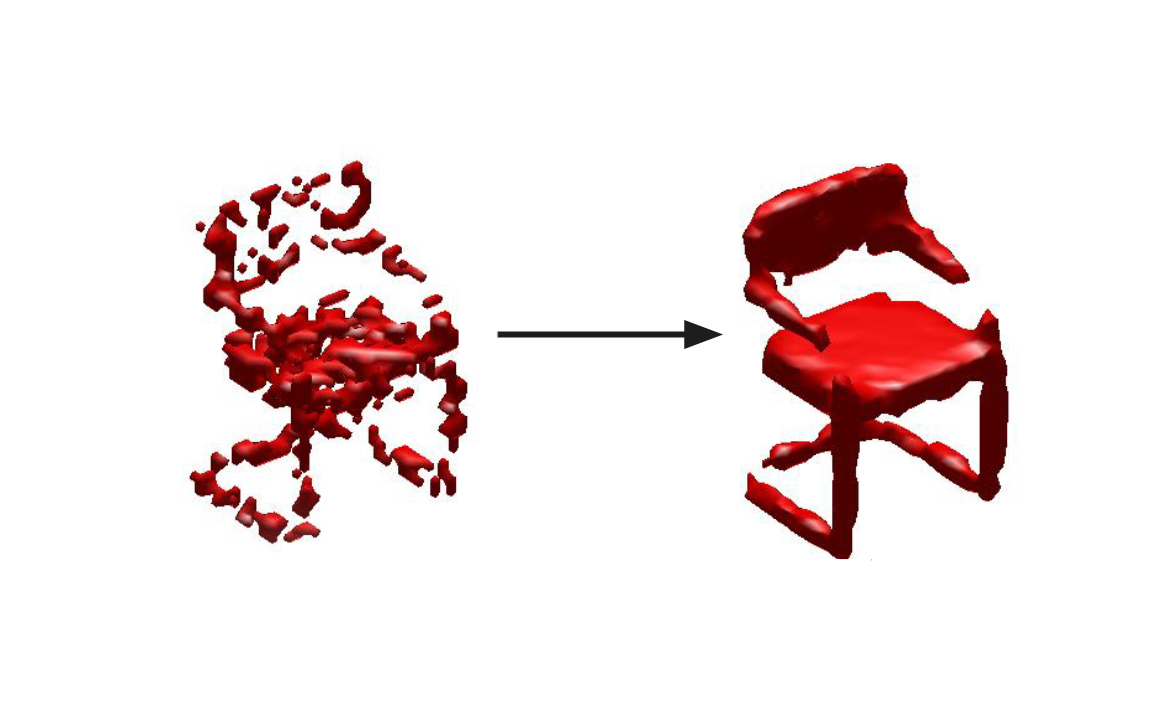

Wissenschaftler der Universität des Saarlandes haben gemeinsam mit Forschern vom Halbleiterhersteller Intel und dem Intel Visual Computing Institute der Saar-Uni eine Methode entwickelt, die aus unvollständigen 3D-Scan-Daten komplette 3D-Modelle erstellt.

Die 3D-Scan-Technologie hat sich in den letzten Jahren wesentlich verbessert. Trotzdem bleibt es eine immer noch eine herausfordernde Aufgabe Objekte digital zu erfassen. Mario Fritz, Leiter der Informatik-Gruppe Scalable Learning and Perception am Max-Planck-Institut erklärt:

“Obwohl die 3D-Scan-Technologie in den vergangenen Jahren einen erheblichen Sprung gemacht hat, ist es immer noch eine Herausforderung, die Geometrie und Form eines realen Objektes digital und automatisiert zu erfassen.”

Tiefensensoren, wie beispielsweise der Microsoft Kinect Sensor, sind laut Fritz zwar sehr leistungsfähiger, funktionieren aber nicht auf allen Materialien gleich gut. Dies kann zu verrauschten Daten oder auch fehlerhaften Messwerten führen:

„Die daraus resultierenden fehlerhaften oder sogar unvollständigen 3D-Geometrien stellen dann ein echtes Problem für eine Reihe von Anwendungen dar, etwa in der virtuellen, erweiterten Realität oder bei der Zusammenarbeit mit Robotern und im 3D-Druck.”

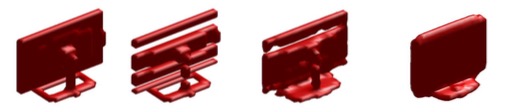

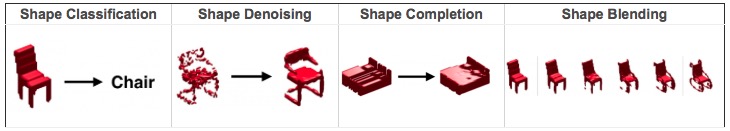

Die von den Wissenschaftlern entwickelte neue Methode nutzt ein spezielles neuronales Netzwerk und benötigt während der Lernphase keinerlei Aufsicht. Damit wurde beispielsweise die 3D-Scan-Daten eines Monitors so rekonstruiert und vervollständigt, dass das digitale Objekt auch tatsächlich als Monitor erkennbar war.

Dieses Verfahren soll bisherigen Methoden zur Vervollständigung fehlerhafter 3D-Scan-Daten überlegen sein und zeigt auch bei der Klassifizierung von gescannten Objekten sehr gute Ergebnisse. Nun planen die Saarbrückner Forscher ihre Methode so weiter zu entwickelten, dass sie auch bei verformbaren Objekten und größeren Szenen funktioniert.

“Zukünftig muss es einfach und schnell gelingen, Objekte aus der echten Welt zu erfassen und diese realitätsnah in die digitale Welt zu projizieren”, sagt Philipp Slusallek, Professor für Computergraphik der Universität des Saarlandes und wissenschaftlicher Direktor am Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI).

Am DFKI ist er auch für das europäische Verbundprojekt Distributed 3D Object Design, kurz DISTRO, verantwortlich, mit dem die Europäische Union die Forschungsdisziplinen Visual Computing und 3D-Computergrafik an die wissenschaftliche Weltspitze bringen will.

Hier kann das Paper “VConv-DAE: Deep Volumetric Shape Learning Without Object Labels” nachgelesen werden.